Métricas que destruyen producto

Medir no siempre mejora el producto. Algunas métricas, usadas fuera de contexto, empujan al equipo a optimizar indicadores en lugar de optimizar valor. Aquí revisamos casos reales donde medir mal termina perjudicando el resultado.

En muchas organizaciones se asume que medir siempre es algo positivo y que cuantos más indicadores tengamos, más control tendremos.

Y que con más control, los resultados deberían mejorar.

Por eso aparecen métricas por todas partes: Velocidad por sprint / Porcentaje de cumplimiento de roadmap / Número de historias completadas / Fechas comprometidas / Productividad del equipo / SLA / KPIs financieros / OKRs / Reportes en general.

Las métricas nos ayudan a entender cómo va el producto, detectar problemas con anticipación, tomar mejores decisiones y alinear al equipo con los objetivos del negocio.

Pero en la práctica, no siempre ocurre así:

En muchas organizaciones empiezan a notar algo extraño.

Mientras se crean más métricas, más presión siente el equipo.

Cuanto más se mide, más se optimiza el número… y menos se optimiza el valor.

Los equipos entregan más, pero el producto no mejora.

Se cumplen los indicadores, pero los problemas siguen ahí.

Esto pasa porque no todas las métricas son neutrales.

Una métrica no solo mide el comportamiento, también lo condiciona.

Cuando una métrica se convierte en objetivo, las personas empiezan a trabajar para cumplir la métrica, aunque eso vaya en contra del producto, del usuario o incluso del propio negocio.

• Historias estimadas más grandes para mantener la velocidad.

• Funcionalidades pequeñas para aumentar el número de entregas.

• Roadmaps que no cambian aunque el contexto haya cambiado.

• Fechas que se cumplen en el reporte, pero no en la realidad.

• Equipos ocupados al 100%, pero sin capacidad para mejorar nada.

EL PROBLEMA NO ES QUE LAS MÉTRICAS SEAN MALAS.

El problema es que muchas veces se usan fuera de contexto, se convierten en instrumentos de control en lugar de herramientas de aprendizaje, o se aplican en sistemas organizacionales que no están preparados para usarlas bien.

Y cuando eso ocurre, la métrica deja de ayudar… y empieza a destruir producto.

En este artículo vamos a ver algunas de las métricas que con más frecuencia generan este efecto.

No porque sean incorrectas por definición, sino porque en la práctica se usan de forma que empujan al equipo a optimizar el indicador en lugar de optimizar el valor.

También veremos para qué sí sirven, cuándo tienen sentido, qué errores se repiten con más frecuencia y qué alternativas suelen funcionar mejor en entornos reales.

POR QUÉ UNA BUENA MÉTRICA PUEDE CAMBIAR DE UNA HERRAMIENTA DE APRENDIZAJE A MECANISMO DE CONTROL

En teoría, las métricas existen para ayudarnos a entender mejor lo que está pasando.

Sirven para detectar problemas antes, tomar decisiones con más información y ver si realmente estamos avanzando hacia los objetivos del producto.

Sin embargo, en la práctica, muchas métricas terminan generando exactamente el efecto contrario.

En lugar de ayudar a mejorar, empiezan a empujar al equipo a comportarse de forma artificial para cumplir el indicador, aunque eso no mejore el producto.

Este fenómeno no es nuevo, ni exclusivo del mundo del software.

De hecho, está descrito desde hace décadas en economía, gestión y ciencias sociales.

Una de las formulaciones más conocidas es la llamada Ley de Goodhart.

Cuando una medida se convierte en objetivo, deja de ser una buena medida.

El problema no era el indicador en sí.

El problema era que, al convertirlo en objetivo, las personas empezaban a optimizar el número, no el sistema.

Con el tiempo, esta idea se popularizó en gestión, psicología organizacional y teoría de sistemas, y hoy se aplica perfectamente al desarrollo de producto, a la agilidad y a la gestión de equipos.

Cuando una organización dice que tenemos que:

• Aumentar la velocidad en los equipos

• Cumplir el roadmap del proyecto

• Cerrar más historias por sprint

• Llegar al 100 % de utilización de la capacidad del equipo

• Cumplir con la fecha comprometida

Lo que se hace muchas veces, sin darse cuenta, es convertir la métrica en el objetivo.

Y en ese momento empiezan a aparecer comportamientos predecibles:

• Se inflan estimaciones para mantener la velocidad

• Se dividen historias para aumentar el conteo

• Se evita trabajo complejo para no romper el plan

• Se prioriza lo que se puede medir, no lo que aporta valor

• Se reporta lo que queda bien, no lo que realmente pasa

La métrica sigue existiendo, pero deja de representar la realidad.

Pasa a representar el comportamiento necesario para que el indicador salga bien.

Este efecto no tiene que ver con que los equipos quieran engañar al sistema.

Tiene que ver con que las personas se adaptan a la forma en la que se les evalúa.

Si la evaluación se basa en cumplir números, el sistema empuja a cumplir números.

Si la evaluación se basa en entregar valor, el sistema empuja a entregar valor.

Por eso el problema no suele ser la métrica aislada, sino el contexto en el que se usa.

SI las métricas las empleamos para aprender, pueden ser muy útiles.

PERO si las utilizamos para controlar, comparar o presionar, empiezan a distorsionar el comportamiento.

Y esto es especialmente frecuente en organizaciones, donde conviven: planificación anual / reporting ejecutivo / presupuestos cerrados / compromisos previos al desarrollo / estructuras jerárquicas / necesidad de previsibilidad

En ese contexto: Las métricas dejan de ser una herramienta para mejorar el producto y se convierten en un mecanismo para demostrar que todo va según el plan.

MÉTRICAS QUE SUELEN DESTRUIR PRODUCTO EN LA PRÁCTICA

No son malas por definición, pero usadas mal generan efectos muy negativos

Velocidad usada como KPI de productividad

Story points como medida de rendimiento del equipo

Porcentaje de cumplimiento de roadmap

Número de funcionalidades entregadas

Utilización del equipo al 100 %

6 Cumplimiento de fechas comprometidas como principal indicador

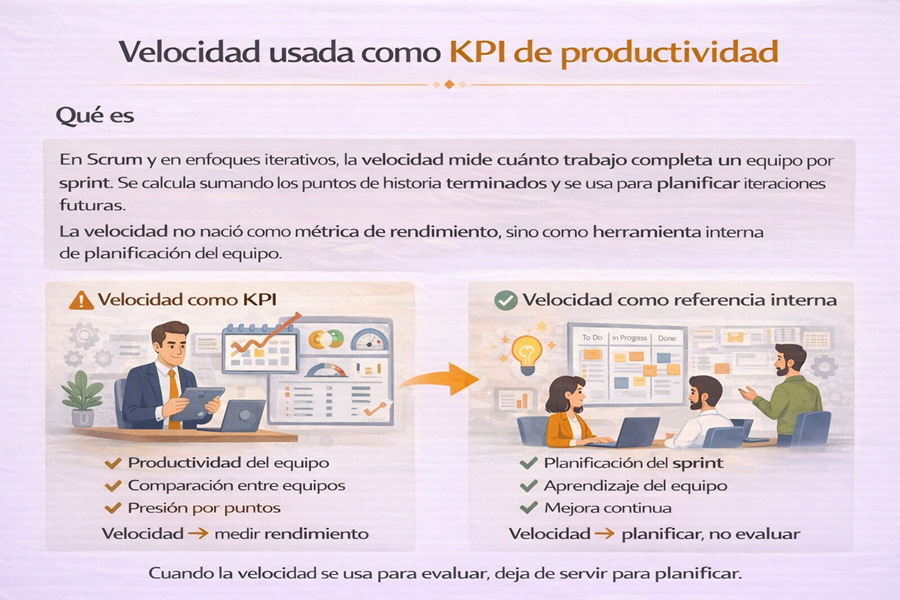

1. Velocidad usada como KPI de productividad

Qué es

Sirve para tener una idea aproximada de cuánto trabajo cabe en un sprint, basándose en la experiencia real de iteraciones anteriores.

Sin embargo, en muchas organizaciones la velocidad termina utilizándose como indicador de productividad, como forma de comparar equipos o incluso como KPI que se reporta a dirección.

Y ahí es donde empiezan los problemas.

Para qué SÍ sirve

Usada correctamente, la velocidad puede ser útil para:

• Ayudar al equipo a planificar de forma más realista

• Detectar cambios grandes en la capacidad del equipo

• Mejorar la previsibilidad a corto plazo

• Facilitar conversaciones sobre alcance y compromiso

Siempre que se entienda que:

• Velocidad es relativa al equipo

• No sirve para comparar equipos

• No mide valor

• No mide productividad

• No mide calidad

Su objetivo no es evaluar, sino aprender.

Cuando se usa mal

La velocidad empieza a volverse peligrosa cuando deja de ser una herramienta del equipo y pasa a ser un indicador para gestión, reporting o evaluación.

Por ejemplo, cuando se usa para:

• Comparar equipos entre sí

• Medir productividad individual o colectiva

• Exigir que la velocidad aumente sprint tras sprint

• Justificar que el equipo está trabajando lo suficiente

• Demostrar a dirección que el proyecto avanza

En ese momento, la métrica deja de reflejar la realidad del trabajo y empieza a reflejar el comportamiento necesario para que el número salga bien.

Según la Ley de Goodhart, es el momento en el que la métrica deja de ser fiable.

Errores comunes

Algunos de los errores más habituales cuando se usa la velocidad como KPI son:

• Comparar la velocidad de equipos distintos

• Pedir que la velocidad aumente cada sprint

• Usar la velocidad para evaluar rendimiento

• Usar la velocidad para comprometer fechas a largo plazo

• Usar la velocidad como métrica para dirección

• Asociar velocidad alta con buen equipo

• Asociar velocidad baja con bajo rendimiento

Todos estos usos ignoran que los puntos de historia no son una unidad objetiva, sino una referencia relativa definida por cada equipo.

Un ejemplo real

Un equipo trabaja en un producto digital dentro de una organización grande.

Durante varios sprints, la velocidad media se mantiene en torno a 40 puntos.

En una revisión de seguimiento, dirección pregunta por qué la velocidad no aumenta,

y se plantea como objetivo llegar a 60 puntos por sprint antes de final de trimestre.

A partir de ese momento empiezan a pasar cosas como:

• Historias que se estiman con más puntos

• Se dividen historias para cerrar más rápido

• Se evita trabajo técnico complejo

• Se priorizan tareas fáciles sobre tareas importantes

• Se reduce el tiempo dedicado a refactor o mejora interna

La velocidad sube.

El indicador mejora.

El producto NO.

Riesgo habitual

Cuando la velocidad se usa como KPI, suelen aparecer patrones muy parecidos:

• Inflación de estimaciones

• Pérdida de comparabilidad entre sprints

• Presión artificial sobre el equipo

• Decisiones orientadas al número, no al valor

• Menos trabajo técnico invisible pero necesario

• Menor calidad a medio plazo

• Falsa sensación de control

El resultado es que la organización cree que el equipo está entregando más, cuando en realidad solo está optimizando la métrica.

Alternativa más sana

En lugar de usar la velocidad como indicador de productividad, suele ser más útil:

• Usar la velocidad solo para planificación interna

• Combinarla con métricas de flujo (lead time, cycle time, throughput)

• Medir impacto en lugar de puntos

• Revisar resultados del producto, no solo entrega

• Evitar usar métricas de equipo como KPI organizacional

La velocidad puede ser útil dentro del equipo.

Pero cuando se convierte en indicador para fuera, deja de ayudar y empieza a distorsionar el comportamiento.

2. Story points como medida de rendimiento del equipo**

Qué es

El objetivo original de los story points es ayudar al equipo a comparar unas historias con otras y poder planificar de forma más realista, sin necesidad de estimar en horas.

Sin embargo, en la práctica, los story points a menudo terminan utilizándose como si fueran una unidad objetiva de productividad, y se convierten en un indicador para medir cuánto trabaja un equipo o cuánto produce en cada sprint.

Cuando esto ocurre, la estimación deja de ser una herramienta para planificar

y pasa a ser una herramienta para evaluar.

Y en ese momento empieza a distorsionarse.

Para qué SÍ sirve

Usados correctamente, los story points pueden ser útiles para:

• Comparar tamaño relativo entre historias

• Facilitar la planificación de sprint

• Mejorar la previsibilidad con el tiempo

• Ayudar al equipo a discutir complejidad

• Detectar historias demasiado grandes o mal definidas

Funcionan bien cuando:

• Los define el propio equipo

• No se usan para comparar equipos

• No se convierten en objetivo

• No se traducen directamente a horas

• No se usan para evaluar rendimiento

Su utilidad está en la conversación, no en el número.

Cuando se usa mal

Los problemas empiezan cuando los story points se interpretan como si fueran una unidad objetiva de trabajo.

Por ejemplo, cuando se usan para:

• Medir productividad del equipo

• Medir productividad individual

• Comparar equipos distintos

• Calcular coste por punto

• Exigir más puntos por sprint

• Convertir puntos en horas de forma rígida

• Reportar puntos a dirección como indicador de avance

En ese momento, el equipo deja de estimar para entender el trabajo

y empieza a estimar para que el número salga bien.

Y cuando la estimación se convierte en objetivo, deja de ser útil.

Errores comunes

Algunos errores muy habituales son:

• Asumir que 1 punto equivale a X horas

• Pedir estimaciones más altas para justificar esfuerzo

• Usar puntos para evaluar desempeño individual

• Comparar equipos por puntos entregados

• Usar puntos como base para contratos o presupuestos

• Exigir coherencia exacta entre equipos

• Usar puntos como métrica financiera

Estos usos ignoran que los story points son una referencia interna,

no una unidad universal.

Un ejemplo real

En un programa con varios equipos, se decide reportar el avance del proyecto en función de los story points completados cada sprint.

Dirección empieza a comparar equipos:

• Equipo A → 50 puntos por sprint

• Equipo B → 30 puntos por sprint

• Equipo C → 70 puntos por sprint

Se concluye que algunos equipos son más productivos que otros.

A partir de ese momento empiezan a aparecer comportamientos como:

• Estimaciones más altas para no parecer lentos

• Historias divididas artificialmente

• Discusiones interminables sobre puntos

• Presión para aceptar estimaciones más grandes

• Resistencia a estimar bajo

El número de puntos aumenta.

La información útil disminuye.

El indicador mejora.

La capacidad de planificar empeora.

Riesgo habitual

Cuando los story points se usan como métrica de rendimiento, suelen aparecer:

• Inflación de estimaciones

• Pérdida de consistencia

• Comparaciones injustas entre equipos

• Presión innecesaria

• Pérdida de foco en valor

• Discusiones sobre números en lugar de sobre producto

• Menor confianza en las estimaciones

Con el tiempo, el equipo deja de creer en la estimación

y la convierte en un trámite para cumplir el proceso.

Alternativa más sana

Algunas prácticas que suelen funcionar mejor:

• Usar story points solo dentro del equipo

• No comparar puntos entre equipos

• No traducir puntos a horas

• Usar métricas de flujo para seguimiento

• Medir resultados del producto, no solo estimaciones

• Aceptar que la estimación es aproximada

Cuando los story points se usan como herramienta de conversación, ayudan.

Cuando se usan como indicador de rendimiento, empiezan a distorsionar el sistema.

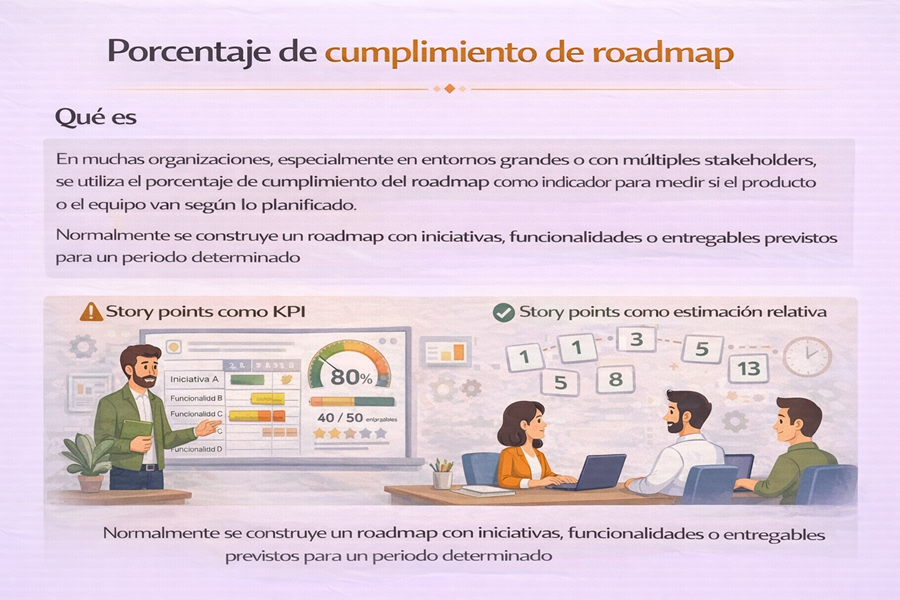

3. Porcentaje de cumplimiento de roadmap

Qué es

Por ejemplo:

• Trimestre

• Semestre

• Año

• PI / Program Increment

• Plan anual

• Plan aprobado por comité o PMO

A partir de ahí, se mide cuánto de lo planificado se ha completado, y se expresa en forma de porcentaje:

• 80 % del roadmap cumplido

• 60 % de iniciativas entregadas

• 90 % del plan ejecutado

• desviación vs plan

Sobre el papel, parece una métrica razonable.

Si se planificó algo, lo lógico sería comprobar si se cumplió.

El problema aparece cuando el cumplimiento del roadmap se convierte en el objetivo principal, y no en una referencia.

Para qué SÍ sirve

El seguimiento del roadmap puede ser útil cuando se usa con el contexto adecuado, por ejemplo para:

• Dar visibilidad a dirección sobre el estado general

• Detectar retrasos importantes

• Identificar dependencias que afectan al plan

• Revisar si la capacidad es suficiente

• Ajustar expectativas con stakeholders

También puede ser útil en entornos donde existen compromisos externos, regulatorios o contractuales, donde no todo puede cambiar continuamente.

El problema no es tener roadmap.

El problema es tratarlo como si fuera inamovible.

Cuando se usa mal

La métrica empieza a volverse peligrosa cuando el foco deja de ser el valor del producto

y pasa a ser el cumplimiento del plan.

Por ejemplo, cuando:

• Cambiar el roadmap se interpreta como fallo

• Se penaliza no cumplir lo planificado

• Se mide el éxito por % ejecutado

• Se prioriza terminar lo comprometido aunque ya no tenga sentido

• Se evita replantear decisiones para no afectar el indicador

En ese momento, el roadmap deja de ser una herramienta de alineamiento

y se convierte en una restricción.

Y según la lógica de Goodhart, cuando cumplir el plan se vuelve el objetivo,

el plan deja de reflejar la realidad.

Errores comunes

Algunos errores muy frecuentes cuando se usa el cumplimiento de roadmap como KPI:

• Crear roadmaps demasiado detallados a largo plazo

• Comprometer funcionalidades antes de entenderlas

• no permitir cambios aunque cambie el contexto

• Medir éxito por entrega, no por impacto

• Usar el roadmap como contrato fijo

• Confundir previsión con compromiso

• Reportar porcentaje cumplido sin revisar si sigue teniendo sentido

Estos errores suelen aparecer cuando el roadmap se usa más para control que para dirección.

Un ejemplo real

Un área de producto define un roadmap anual aprobado por dirección.

Incluye una lista de funcionalidades que deben entregarse durante el año.

Durante el segundo trimestre, el equipo descubre que:

• Algunas funcionalidades no aportan el valor esperado

• Aparecen nuevas necesidades más importantes

• Hay cambios en el mercado

• Hay dependencias no previstas

El equipo propone ajustar el roadmap.

La respuesta es:

No podemos cambiarlo, porque está comprometido.

A partir de ahí empiezan a ocurrir cosas típicas:

• Se entregan funcionalidades que ya no son prioritarias

• Se retrasa trabajo importante porque no estaba en el plan

• Se evita replantear decisiones

• Se prioriza cumplir el roadmap sobre mejorar el producto

El porcentaje de cumplimiento es alto.

La satisfacción del usuario no.

Riesgo habitual

Cuando el cumplimiento de roadmap se convierte en la métrica principal, suelen aparecer estos efectos:

• Menor capacidad de adaptación

• Decisiones orientadas al plan, no al valor

• Resistencia al cambio

• Falsa sensación de control

• Presión por cerrar iniciativas aunque no estén maduras

• Backlog condicionado por compromisos previos

• Pérdida de autonomía del equipo

Con el tiempo, el roadmap deja de ser una guía y pasa a ser una obligación.

Alternativa más sana

Algunas prácticas que suelen funcionar mejor:

• Usar el roadmap como dirección, no como contrato

• Revisar el roadmap periódicamente

• Separar objetivos de soluciones

• Medir impacto, no solo entrega

• Permitir cambios cuando hay nueva información

• Combinar roadmap con priorización continua

En muchos entornos, el roadmap sigue siendo necesario.

Pero cuando el éxito se mide solo por cumplirlo, el producto deja de evolucionar.

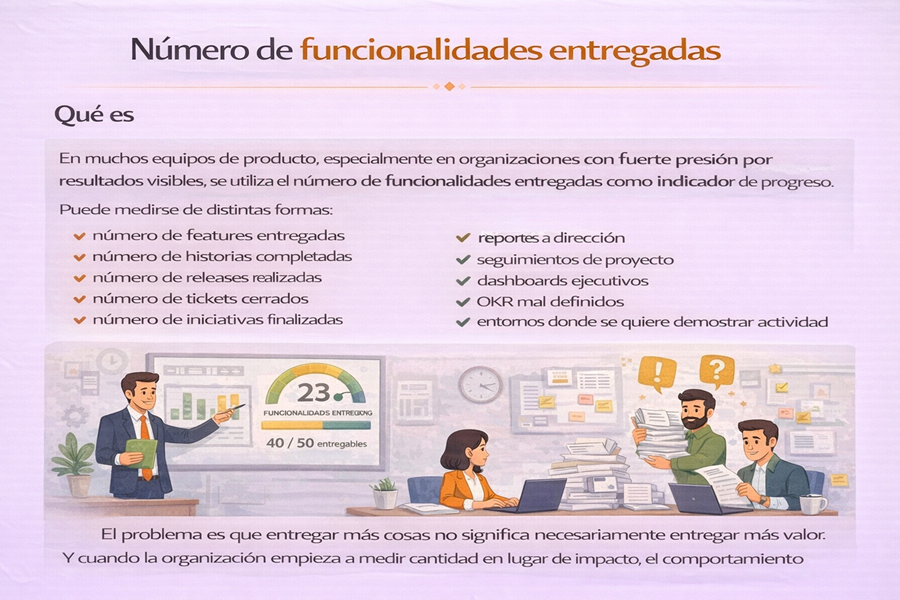

4. Número de funcionalidades entregadas

Qué es

El problema es que entregar más cosas no significa necesariamente entregar más valor.

Y cuando la organización empieza a medir cantidad en lugar de impacto, el comportamiento del equipo cambia.

Para qué SÍ sirve

Medir entregas puede tener sentido en algunos contextos, por ejemplo para:

• Tener visibilidad del flujo de trabajo

• Detectar bloqueos o cuellos de botella

• Ver si el equipo está pudiendo terminar lo que empieza

• Entender la capacidad de entrega a corto plazo

• Analizar tendencias en el tiempo

También puede ser útil cuando se combina con otras métricas, como:

• Lead time

• Throughput

• Cycle time

• Impacto en usuario

• Métricas de negocio

El problema aparece cuando se usa como indicador principal de éxito.

Cuando se usa mal

La métrica empieza a volverse peligrosa cuando el foco pasa de:

ENTREGAR VALOR

A

ENTREGAR COSAS

Por ejemplo, cuando:

• Se pide aumentar el número de funcionalidades por sprint

• Se mide al equipo por cantidad de entregas

• Se reporta progreso en función de tickets cerrados

• Se premia terminar features aunque no se usen

• Se define el éxito por volumen de trabajo entregado

En ese momento, el sistema empuja al equipo a optimizar la cantidad, no el resultado.

Y según la Ley de Goodhart, cuando la cantidad se convierte en objetivo, deja de ser un buen indicador.

Errores comunes

Errores muy habituales cuando se usa esta métrica:

• medir productividad por número de features

• dividir funcionalidades para que cuenten más

• priorizar lo pequeño sobre lo importante

• evitar trabajo técnico porque no se ve

• definir OKR basados en entregables

• confundir actividad con progreso

• usar dashboards con conteos sin contexto

Esto suele llevar a lo que se conoce como feature factory:

equipos que no paran de entregar, pero sin mejorar realmente el producto.

Un Ejemplo real

Un equipo de producto trabaja en una aplicación digital.

En los reportes mensuales se muestra el número de funcionalidades entregadas.

Dirección empieza a pedir que ese número aumente.

A partir de ese momento:

• se dividen features en partes más pequeñas

• se priorizan cambios rápidos

• se pospone refactorización

• se evita trabajo técnico complejo

• se entregan mejoras poco relevantes

• se reducen experimentos porque no cuentan como entrega

El número de funcionalidades sube.

Los reportes mejoran.

La calidad del producto no.

Incluso puede empeorar.

Riesgo habitual

Cuando se mide éxito por número de entregas, suelen aparecer estos efectos:

• Priorización orientada al corto plazo

• Acumulación de deuda técnica

• Menor calidad

• Menos innovación

• Menos experimentación

• Backlog lleno de cosas pequeñas

• Pérdida de foco en usuario

Con el tiempo, el equipo trabaja para producir entregables, no para resolver problemas.

Alternativa más sana

Algunas prácticas más equilibradas:

• Medir impacto en usuario, no solo entregas

• Combinar output con outcome

• Revisar si las funcionalidades se usan

• Incluir métricas de negocio

• Valorar también el trabajo técnico

• Medir aprendizaje, no solo entrega

Entregar funcionalidades es necesario.

Pero cuando el éxito se mide solo por cuántas se entregan, el producto empieza a perder dirección.

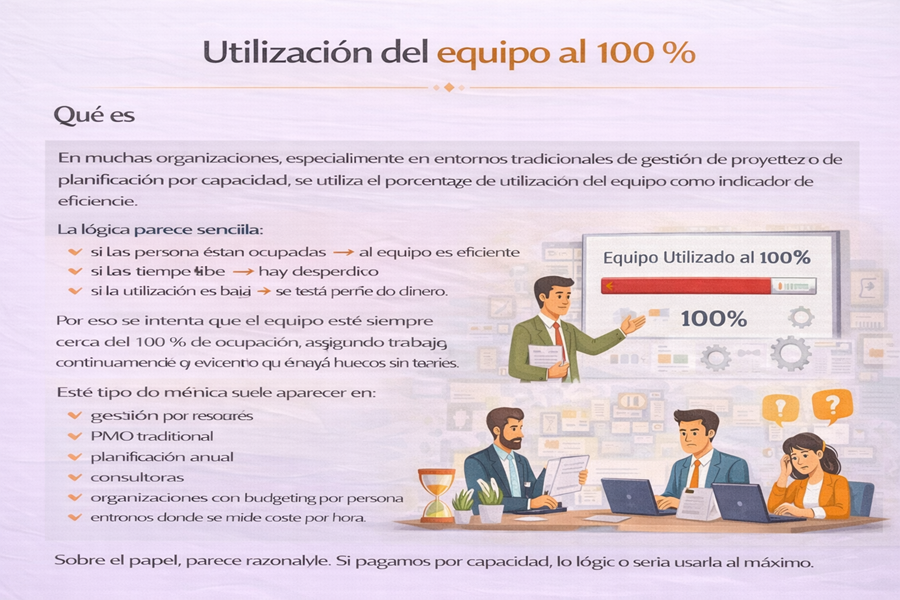

5. Utilización del equipo al 100 %

Qué es

Si pagamos por capacidad, lo lógico sería usarla al máximo.

El problema es que en desarrollo de producto, maximizar la utilización suele reducir la velocidad real del sistema.

Para qué SÍ sirve

Medir utilización puede tener sentido en algunos contextos, por ejemplo para:

• Detectar equipos sobrecargados

• Ver si hay desequilibrios grandes de capacidad

• Identificar cuellos de botella

• Planificar contratación o reasignación

• Entornos muy operativos o repetitivos

También puede ser útil cuando se usa como referencia, no como objetivo.

El problema aparece cuando se intenta mantener la utilización constantemente al máximo.

Cuando se usa mal

La métrica empieza a volverse peligrosa cuando se asume que:

cuanto más ocupado está el equipo, más rápido avanza el producto

En realidad, ocurre lo contrario.

Cuando la utilización está cerca del 100 %:

• Aumenta el trabajo en paralelo, las colas, el tiempo de espera, la multitarea

• Disminuye la capacidad de reaccionar, la calidad

Esto está muy estudiado en teoría de sistemas y teoría de colas:

los sistemas con utilización cercana al 100 % se vuelven inestables.

Pero en muchas organizaciones se sigue persiguiendo ese número.

Errores comunes

Errores típicos cuando se usa la utilización como KPI:

• Asignar trabajo a todas las personas en todo momento

• Planificar al 100 % de capacidad

• Penalizar tiempo sin tareas

• Medir eficiencia por horas ocupadas

• Repartir a las personas en muchos proyectos

• Evitar slack o margen

• Ver el tiempo libre como desperdicio

Esto genera equipos ocupados

pero sistemas lentos.

Un ejemplo real

Un equipo trabaja en varios proyectos a la vez.

Para asegurar que nadie esté sin trabajo, se asignan tareas de distintos proyectos en paralelo.

Cada persona tiene:

• Tareas del proyecto A

• Tareas del proyecto B

• Tareas del proyecto C

• Soporte

• Incidencias

La utilización es cercana al 100 %.

Pero empiezan a aparecer problemas:

• Cambios constantes de contexto

• Tareas que se quedan a medias

• Retrasos acumulados

• Dependencia entre personas

• Dificultad para terminar cosas

El equipo está siempre ocupado,

pero las entregas tardan más.

La eficiencia aparente aumenta.

La eficiencia real baja.

Riesgo habitual

Cuando se busca utilización máxima, suelen aparecer:

• Multitarea excesiva

• Aumento del lead time

• Más errores

• Menos calidad

• Menos innovación

• Más estrés en el equipo

• Menor capacidad de adaptación

• Dificultad para priorizar

Además, se pierde algo muy importante en producto:

Un equipo al 100 % no tiene espacio para mejorar el sistema.

Alternativa más sana

Algunas prácticas que suelen funcionar mejor:

• Planificar por flujo, no por ocupación

• Aceptar que el slack es necesario

• Limitar trabajo en curso (WIP)

• Evitar multitarea excesiva

• Medir lead time y throughput

• Dejar margen para mejora y aprendizaje

• Optimizar el sistema, no la persona

En desarrollo de producto, el objetivo no es que todos estén ocupados todo el tiempo.

El objetivo es que el sistema entregue valor de forma fluida.

Y para eso, el 100 % de utilización suele ser un problema, no una solución.

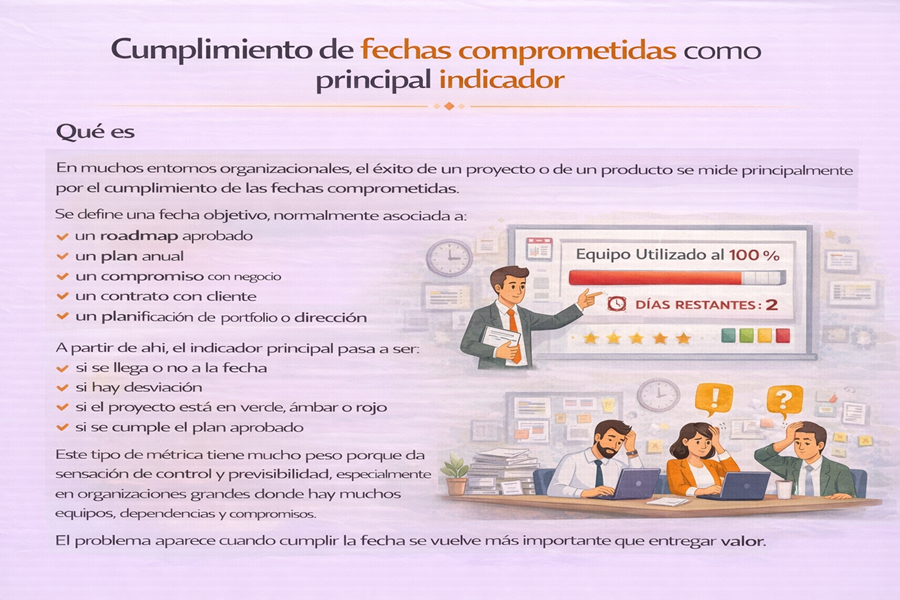

6. Cumplimiento de fechas comprometidas como principal indicador

Qué es

Este tipo de métrica tiene mucho peso porque da sensación de control y previsibilidad, especialmente en organizaciones grandes donde hay muchos equipos, dependencias y compromisos.

El problema aparece cuando cumplir la fecha se vuelve más importante que entregar valor.

Para qué SÍ sirve

Medir fechas puede ser necesario en algunos contextos, por ejemplo:

Cuando hay compromisos regulatorios, contratos externos, campañas con fecha fija, dependencias críticas, planificación financiera asociada.

En estos casos, tener visibilidad sobre fechas ayuda a gestionar expectativas y coordinar a muchas áreas.

El problema no es tener fechas.

El problema es convertirlas en el único criterio de éxito.

Cuando se usa mal

La métrica empieza a volverse peligrosa cuando el objetivo pasa a ser:

llegar a la fecha, pase lo que pase

En lugar de:

entregar algo útil en la fecha adecuada

Esto suele ocurrir cuando:

• Cambiar la fecha se interpreta como fracaso

• Se penaliza cualquier desviación

• Se comprometen fechas antes de entender el trabajo

• Planificación con demasiada antelación

• Medción del éxito solo por cumplimiento

En ese momento, el sistema empuja al equipo a proteger la fecha, no el producto.

Y aparecen comportamientos previsibles.

Errores comunes

Errores muy frecuentes cuando se usa el cumplimiento de fechas como KPI principal:

• Comprometer fechas antes de tener claridad

• No permitir ajustar alcance

• No permitir revisar prioridades

• Planificar a largo plazo con demasiado detalle

• Presionar al equipo para cumplir sí o sí

• Medir éxito por calendario, no por resultado

• Mantener planes aunque el contexto cambie

Esto suele generar la ilusión de control,

pero reduce la capacidad de adaptación.

Un ejemplo real

Un área de negocio define que una nueva funcionalidad debe estar lista para una fecha concreta, porque está incluida en el plan anual.

El equipo empieza a trabajar y descubre que:

• La complejidad es mayor de lo esperado

• Hay dependencias no previstas

• Aparecen problemas técnicos

• Surgen nuevas necesidades más importantes

Se propone mover la fecha o ajustar el alcance.

La respuesta es:

la fecha no se puede mover.

A partir de ahí:

• Se reduce calidad

• Se eliminan pruebas

• Se pospone refactorización

• Se entregan soluciones provisionales

• Se prioriza terminar sobre hacerlo bien

La fecha se cumple.

El producto queda peor.

Riesgos habitual

Cuando el cumplimiento de fechas se convierte en el indicador principal, suelen aparecer:

• Presión artificial sobre el equipo

• Reducción de calidad

• Acumulación de deuda técnica

• Menor capacidad de adaptación

• Decisiones orientadas al corto plazo

• Miedo a cambiar el plan

• Pérdida de foco en valor

Con el tiempo, el equipo aprende que lo importante no es hacer lo correcto,

sino cumplir lo prometido.

Y eso termina afectando al producto.

Alternativa más sana

Algunas prácticas más equilibradas:

• Comprometer objetivos, no soluciones cerradas

• Revisar fechas cuando cambia la información

• Permitir ajustar alcance

• Priorizar valor sobre cumplimiento

• Usar fechas como referencia, no como castigo

• Combinar planificación con adaptación

En muchos contextos las fechas son necesarias.

Pero cuando el éxito se mide solo por cumplirlas, el sistema deja de optimizar valor y empieza a optimizar calendario.

EL PROBLEMA NO ES LA MÉTRICA, ES EL SISTEMA DONDE SE USA

El problema aparece cuando esas métricas se usan dentro de estructuras que necesitan control, previsibilidad y reporting constante, incluso en contextos donde el trabajo es incierto.

Y eso ocurre muy a menudo en organizaciones grandes.

En la práctica, muchos equipos de producto trabajan dentro de entornos donde existen al mismo tiempo planificaciones, presupuestos, compromisos cerrados desde la dirección y un mar de reportes. Y esto decanta en indicadores que a los directivos les dé seguridad.

Para aplacar el temor y asi dar seguridad, aparecen indicadores conocidos (velocidad, % de roadmap, fechas cumplidas, etc) que son fáciles de mostrar, pero el PROBLEMA REAL ES QUE UN DESARROLLO DE PRODUCTO NO ES PREDECIBLE AL NIVEL QUE DEMANDAN DESDE EL "OLIMPO".

Trabajar en producto implica:

• Incertidumbre

• Cambios de contexto

• Aprendizaje continuo

• Decisiones que se revisan

• Problemas que no se conocen al inicio

• Necesidades que evolucionan

Cuando se intenta gestionar ese tipo de trabajo con métricas pensadas para entornos estables, lo que ocurre no es más control, sino más distorsión.

• El equipo empieza a adaptarse a la métrica en lugar de adaptarse al problema.

• Se optimiza el indicador, no el resultado.

• Se protege el plan, no el producto.

• Se cumple el reporte, pero no necesariamente se mejora lo que se está construyendo.

Luego muchas organizaciones dicen trabajar de forma ágil, pero siguen teniendo los mismos problemas de siempre, y mientras el sistema no cambie, las métricas seguirán empujando al equipo en la dirección equivocada.

Entonces, la solución no suele ser eliminar las métricas, sino entender para qué se usan, quién las necesita y qué comportamiento están generando.

Solo cuando se revisa eso, las métricas vuelven a ser una herramienta útil en lugar de convertirse en una fuente de presión.

CÓMO USAR MÉTRICAS SIN DESTRUIR EL PRODUCTO

No vamos a eliminar métricas, sino que lo mejor es cambiar la forma en que se interpretan y se usan.

A continuación, algunas prácticas que ayudan a evitar que las métricas terminen distorsionando el producto.

A. Usar las métricas como señal, no como objetivo

B. Evitar métricas únicas como indicador de éxito

C. Separar métricas de equipo y métricas de negocio

D. Permitir que las métricas evolucionen

E. No usar métricas para evaluar personas

F. Aceptar que no todo lo importante se puede medir fácilmente

G. Medir para mejorar el sistema, no para demostrar que todo va bien

A. Usar las métricas como señal, no como objetivo

Una métrica debería servir para hacer preguntas, no para cerrar conversaciones.

Por ejemplo:

• Si baja la velocidad → entender qué ha pasado

• Si aumenta el lead time → Revisar el flujo

• Si no se cumple el roadmap → Analizar prioridades

• Si hay menos entregas → Ver qué está cambiando

Cuando el número se convierte en objetivo, las personas empiezan a optimizar el número.

Cuando el número se usa como señal, ayuda a entender el sistema.

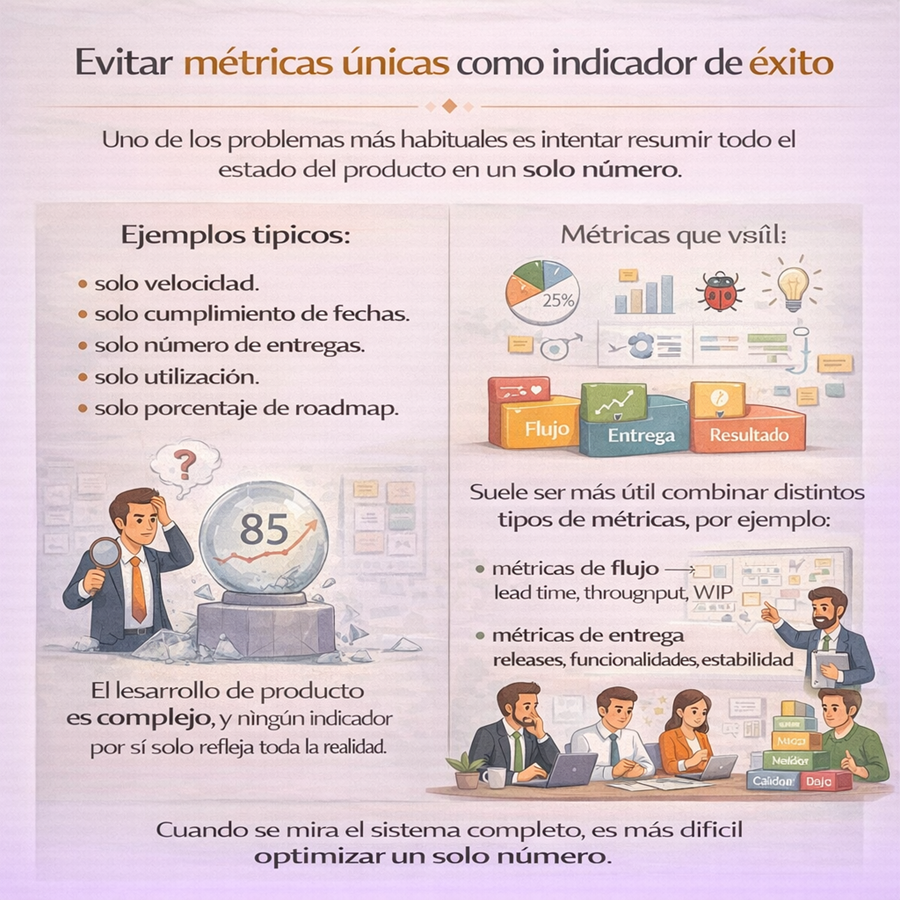

B. Evitar métricas únicas como indicador de éxito

Uno de los problemas más habituales es intentar resumir todo el estado del producto en un solo número.

Ejemplos típicos:

• solo velocidad

• solo cumplimiento de fechas

• solo número de entregas

• solo utilización

• solo porcentaje de roadmap

El desarrollo de producto es complejo, y ningún indicador por sí solo refleja toda la realidad.

Suele ser más útil combinar distintos tipos de métricas, por ejemplo:

• métricas de flujo → lead time, throughput, WIP

• métricas de entrega → releases, funcionalidades, estabilidad

• métricas de resultado → uso, impacto, negocio

• métricas de calidad → bugs, incidencias, retrabajo

Cuando se mira el sistema completo, es más difícil optimizar un solo número.

C. Separar métricas de equipo y métricas de negocio

Otro error muy frecuente es usar métricas del equipo como si fueran métricas organizacionales.

Por ejemplo:

• velocidad reportada a dirección

• story points en dashboards ejecutivos

• número de historias como KPI de área

• utilización como indicador financiero

Las métricas del equipo sirven para que el equipo mejore.

Las métricas de negocio sirven para decidir si el producto va en la dirección correcta.

Cuando se mezclan, se genera presión innecesaria y se pierde información útil.

D. Permitir que las métricas evolucionen

Las métricas que funcionan en un momento pueden dejar de funcionar después.

El contexto cambia:

• cambia el producto

• cambia el equipo

• cambia la organización

• cambian las prioridades

• cambia el mercado

Por eso es importante revisar periódicamente:

• si la métrica sigue siendo útil

• qué comportamiento está generando

• si se está usando para aprender o para controlar

• si está alineada con el objetivo actual

Las métricas no deberían ser permanentes.

Deberían adaptarse igual que el producto.

E. No usar métricas para evaluar personas

Uno de los usos más dañinos de las métricas es cuando se utilizan para evaluar rendimiento individual.

Por ejemplo:

• puntos por persona

• historias por desarrollador

• horas productivas

• tickets cerrados por miembro del equipo

Este tipo de uso genera:

• competencia interna

• falta de colaboración

• optimización individual

• pérdida de confianza

• estimaciones artificiales

El desarrollo de producto es un trabajo de equipo.

Cuando se mide a las personas como si fueran unidades independientes, el sistema deja de funcionar bien.

F. Aceptar que no todo lo importante se puede medir fácilmente

Muchas de las cosas que realmente mejoran un producto no se ven en un dashboard.

Por ejemplo:

• reducir complejidad

• mejorar arquitectura

• aprender de usuarios

• explorar soluciones

• eliminar deuda técnica

• simplificar procesos

Si solo se mide lo visible, el equipo tenderá a trabajar en lo visible.

Por eso, las métricas deben complementar la conversación, no sustituirla.

*G. Medir para mejorar el sistema, no para demostrar que todo va bien

Las métricas son más útiles cuando ayudan a detectar problemas, no cuando solo se usan para confirmar que todo está correcto.

Cuando el objetivo del reporte es quedar bien, la información pierde valor.

Cuando el objetivo es entender el sistema, la información se vuelve útil.

En producto, medir debería servir para tomar mejores decisiones,

no solo para mostrar que se está cumpliendo el plan.

PATRONES QUE INDICAN QUE UNA MÉTRICA ESTÁ HACIENDO DAÑO

No siempre es fácil darse cuenta de que una métrica está generando efectos negativos.

Muchas veces el indicador parece correcto, los reportes salen bien y el plan se está cumpliendo.

Sin embargo, cuando una métrica empieza a utilizarse como objetivo en lugar de como herramienta, suelen aparecer ciertos patrones que se repiten en distintos equipos y organizaciones.

No son errores individuales, sino señales de que el sistema está empujando en la dirección equivocada.

Reconocer estos síntomas es una de las formas más claras de detectar que una métrica está empezando a distorsionar el comportamiento.

El equipo optimiza el número en lugar del RESULTADO

Uno de los signos más claros es cuando las decisiones empiezan a tomarse pensando en el indicador.

Por ejemplo:

• se estiman más puntos para mantener la velocidad

• se dividen historias para cerrar más

• se priorizan tareas pequeñas para mejorar el conteo

• se evita trabajo complejo porque afecta al plan

• se entregan funcionalidades poco relevantes porque cuentan como avance

El equipo no lo hace para engañar,

lo hace porque el sistema premia el número.

Cuando esto ocurre, la métrica ha dejado de reflejar el valor real.

Se EVITA CAMBIAR EL PLAN aunque el contexto haya CAMBIADO

Otro síntoma muy habitual aparece cuando modificar el roadmap, mover una fecha o replantear prioridades se percibe como un problema.

Empiezan a escucharse frases como:

• ya está comprometido

• no podemos cambiarlo ahora

• afecta al indicador

• no queda bien en el reporte

• dirección espera que se cumpla

En ese momento, el plan deja de ser una guía

y pasa a ser una restricción.

Y el equipo empieza a trabajar para cumplir lo prometido,

no para hacer lo correcto.

Prioriza lo visible sobre lo importante

Cuando las métricas se centran en entregas, tickets o funcionalidades, suele aparecer un sesgo hacia lo que se puede mostrar fácilmente.

Por ejemplo:

• se priorizan features visibles

• se pospone trabajo técnico

• se evita refactorización

• se retrasan mejoras internas

• se reduce el tiempo de investigación

• se dejan para después problemas de arquitectura

El producto avanza en lo visible,

pero se debilita por dentro.

Con el tiempo, esto suele generar más lentitud, más errores y más dificultad para evolucionar.

Aumenta la presión, pero no mejora el resultado

Otro patrón muy común es que, a medida que se introducen más métricas, aumenta la sensación de control… pero no necesariamente mejora el producto.

Se añaden:

• más reportes

• más dashboards

• más indicadores

• más seguimiento

• más reuniones de estado

Sin embargo, el equipo sigue teniendo los mismos problemas:

• retrasos

• cambios de prioridad

• dependencias

• falta de claridad

• deuda técnica

• falta de foco

Cuando esto ocurre, muchas veces el problema no es que falten métricas,

sino que se están usando para controlar en lugar de para entender.

El equipo pierde autonomía para tomar decisiones

Cuando las métricas se convierten en KPI organizacionales, el equipo suele tener menos margen para adaptarse.

Por ejemplo:

• no puede cambiar prioridades sin aprobación

• no puede replantear alcance

• no puede dedicar tiempo a mejora

• no puede ajustar el plan

• no puede decir que algo no tiene sentido

La decisión deja de basarse en el producto

y pasa a basarse en el indicador.

Y eso suele reducir la capacidad de responder al cambio, que es precisamente lo que se buscaba mejorar.

Se cumple el indicador, pero el producto no mejora

Este es probablemente el síntoma más claro.

Los números están bien:

• la velocidad se mantiene

• el roadmap se cumple

• las fechas se respetan

• las historias se cierran

• la utilización es alta

Pero al mismo tiempo:

• los usuarios no están satisfechos

• aparecen más incidencias

• cuesta cada vez más cambiar cosas

• el equipo está más cansado

• el backlog crece sin control

• el producto no evoluciona como debería

Cuando esto pasa, la métrica no está ayudando a mejorar. Está ocultando el problema.

Las conversaciones giran más sobre números que sobre el producto y en las reuniones de equipo hablan más de:

• Cuánto se ha entregado

• Cuántos puntos

• Cuántas historias

• Cuánto falta

• Si estamos en verde o en rojo

y menos de:

• Qué problema estamos resolviendo

• Si esto aporta valor

• Qué hemos aprendido

• Qué deberíamos cambiar

• Qué necesita el usuario

Cuando el foco pasa del producto al indicador, lo más probable es que la métrica haga más daño que bien.

MI CONCLUSIÓN

Y llegamos a la conclusión de este artículo, desde ya digo que Medir no es el problema, sino que el problema empieza cuando la métrica deja de servir para entender el sistema y empieza a usarse para controlar, comparar o presionar. Esto ya hemos visto que a veces suceden por distintas razones que manejan las organizaciones.

Esto desencadena en que los equipos dejen de optimizar producto y empiecen a optimizar el número.

Comenzamos a ver el "cambio" cuando el roadmap, las fechas, los indicadores y mas se "ven bien" pero el producto no mejora al mismo ritmo.

Lo que realmente debemos buscar es "medir con sentido"

Entender para qué sirve cada métrica, qué comportamiento está generando y si realmente ayuda a tomar mejores decisiones.

Porque una métrica bien usada puede ayudar mucho.

Pero una métrica mal usada puede dar sensación de control mientras empuja al equipo justo en la dirección contraria.

Lo que deseo que se lleven de este artículo es que el riesgo no es no medir, sino que al medir tantas cosas para los diferentes reportes que tengauna organización, dejamos de lado lo importante: La mejora constante del producto.

El mayor riesgo es medir tanto que dejamos de ver lo que realmente importa.

Gracias a todos los que llegaron hasta el final. Si tienen alguna sugerencia de lagún tópico que tocar, pueden dejarmelo como sugerencia aquí abajo.

Deja un comentario